Wykrywanie dezinformacji nie polega na „przeczuciu”, lecz na systematycznej analizie treści, źródeł i kontekstu. W praktyce łączymy metody dziennikarskie, analityczne oraz narzędzia technologiczne – w tym rozwiązania oparte na sztucznej inteligencji.

1. Podstawowe metody weryfikacji (dostępne dla każdego)

To narzędzia, z których może korzystać każdy odbiorca informacji:

- fact-checking – sprawdzanie konkretnych twierdzeń w wiarygodnych źródłach,

- weryfikacja źródeł – kto publikuje informację, w jakim celu i z jaką historią,

- weryfikacja obrazów i wideo – odwrócone wyszukiwanie grafiki, analiza kontekstu użycia zdjęć,

- porównywanie wersji informacji – zestawianie tej samej wiadomości z relacjami z różnych, niezależnych źródeł,

- analiza narracji – identyfikowanie powtarzalnych schematów emocjonalnych i manipulacyjnych.

2. OSINT – analiza otwartych źródeł

OSINT (Open Source Intelligence) to metodyczna analiza publicznie dostępnych danych, takich jak:

- strony internetowe i archiwa,

- media społecznościowe,

- rejestry publiczne,

- metadane treści cyfrowych.

OSINT pozwala nie tylko sprawdzić czy informacja jest fałszywa, ale także:

- kto ją stworzył,

- jak się rozprzestrzenia,

- jakie interesy może realizować.

Pamiętaj!

Nie ufaj stopce redakcyjnej na stronach www. Sprawdź zakładkę „O nas” – czy są tam nazwiska, adres, czy tylko ogólniki? Wpisz nazwę „eksperta” w cudzysłowie w wyszukiwarkę – czy istnieje poza tym jednym portalem? Sprawdź datę powstania strony (narzędzia typu Whois: https://www.whois.com/whois/). To podstawowy OSINT, który każdy może wykonać w 3 minuty.

3. Narzędzia i metody oparte na sztucznej inteligencji

W szerszym, eksperckim ujęciu wykorzystywane są również technologie AI i uczenia maszynowego:

- automatyczna klasyfikacja treści (ML/DL) – modele analizują styl, emocjonalność i strukturę tekstu,

- zaawansowane modele językowe (np. architektury typu Transformer) – pozwalają wykrywać subtelne manipulacje semantyczne i kontekstowe,

- detekcja multimodalna – jednoczesna analiza tekstu, obrazu, dźwięku i metadanych (np. deepfake),

- systemy oparte na grafach wiedzy – porównywanie twierdzeń z uporządkowanymi bazami faktów (np. w medycynie),

- narzędzia AI do weryfikacji treści, a nie tylko do ich generowania.

4. Metody manualne i kompetencje krytyczne

Niezależnie od technologii, kluczowe znaczenie mają umiejętności krytycznego odbioru informacji:

- weryfikacja lateralna – sprawdzanie istnienia i treści informacji w innych źródłach, a nie tylko na jednej stronie. Zamiast czytać tekst w dół i dać się wciągnąć w narrację, otwórz nowe karty w przeglądarce. Wpisz kluczowe hasła z tekstu w wyszukiwarkę. Sprawdź, czy inne, niezależne źródła (duże media, instytucje naukowe) w ogóle o tym piszą. Jeśli milczą, to gigantyczna czerwona flaga.

- analiza języka – wychwytywanie tzw. technobabbla, absolutów i obietnic gwarantowanych efektów,

- weryfikacja w rejestrach – np. Centralny Rejestr Lekarzy (NIL), URPL, GIS,

- identyfikacja czerwonych flag – presji czasu, tajemnicy, „cudownych rozwiązań”.

Najważniejsza zasada

Sztuczna inteligencja nie jest ani dobra, ani zła – kluczowe jest to, czy służy manipulacji, czy jej demaskowaniu, czy po prostu pomaga w pracy.

Dlatego skuteczna walka z dezinformacją wymaga łączenia technologii z wiedzą prawną, dziennikarską i społeczną – oraz świadomego, odpowiedzialnego odbioru informacji.

Co może zrobić każdy z nas

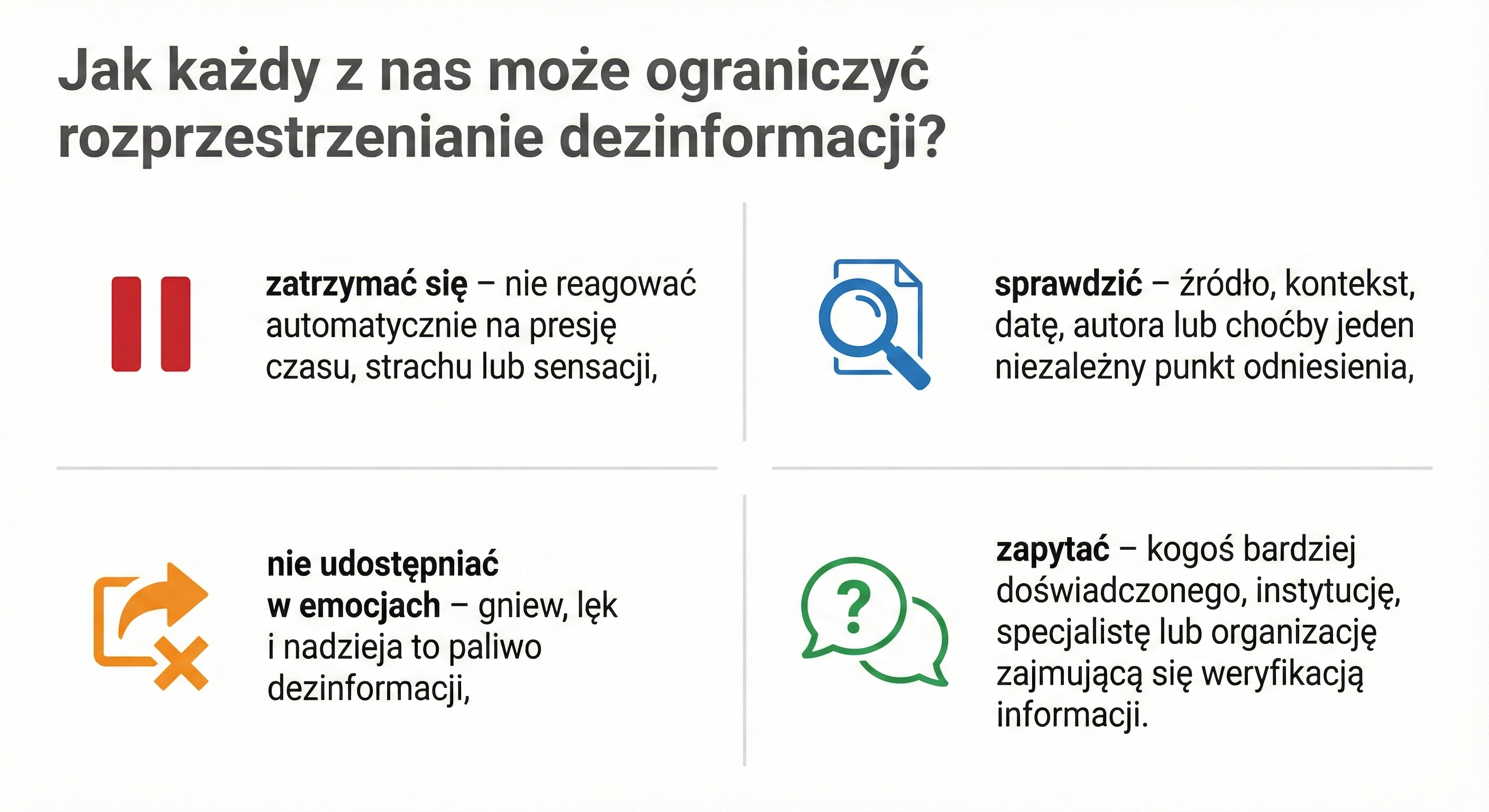

Aby ograniczyć rozprzestrzenianie dezinformacji, wystarczy wykonać cztery kroki:

- zatrzymać się – nie reagować automatycznie na presję czasu, strachu lub sensacji,

- sprawdzić – źródło, kontekst, datę, autora lub choćby jeden niezależny punkt odniesienia,

- nie udostępniać w emocjach – gniew, lęk i nadzieja to paliwo dezinformacji,

- zapytać – kogoś bardziej doświadczonego, instytucję, specjalistę lub organizację zajmującą się weryfikacją informacji.

O metodach demaskowania, przeciwdziałania, zapobiegania oraz o skutkach dezinformacji, a także o przeprowadzonych w tym obszarze działaniach piszemy w kategorii: